Las herramientas propuestas han sido criticadas por expertos en privacidad y seguridad, quienes argumentan que el sistema podría usarse con fines de vigilancia, en particular por parte de gobiernos autoritarios.

Después de recibir fuertes críticas sobre las nuevas funciones que escanearían las fotos de los usuarios en busca de material de abuso infantil (CSAM), Apple retiró la herramienta este año y retrasó su lanzamiento. La empresa, basándose en los comentarios de los clientes, dijo que eligió «dar más tiempo» para «hacer mejoras antes del lanzamiento».

«El mes pasado, anunciamos planes de recursos para ayudar a proteger a los niños de los depredadores que usan herramientas de comunicación para reclutar y explotar material de abuso sexual infantil y limitar su propagación», dijo Apple en un comunicado a The Verge.

«Basándonos en los comentarios de los clientes, grupos de defensa, investigadores y otros, hemos decidido dedicar más tiempo en los próximos meses a recopilar información y realizar mejoras antes de lanzar estas funciones críticas de seguridad infantil».

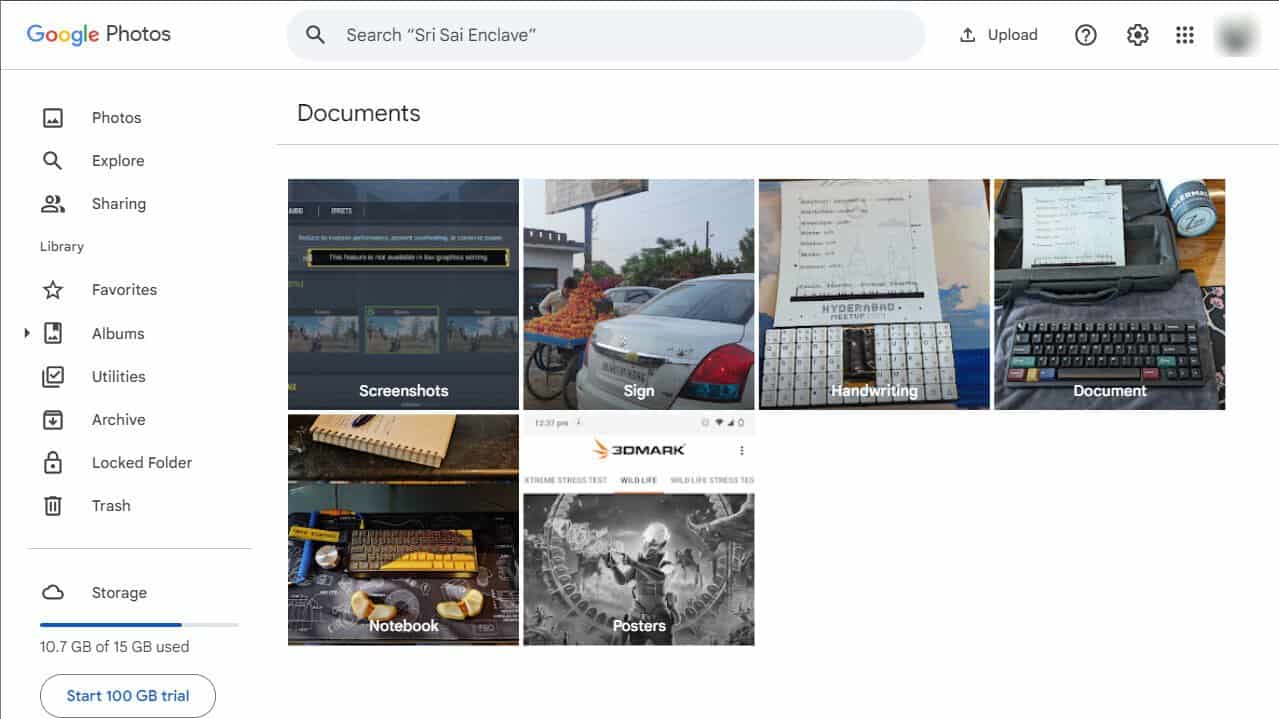

Los cambios de abuso de menores que Apple propuso a principios del mes pasado incluían una herramienta diseñada para detectar fotos conocidas de abuso de menores, escanear las fotos de los usuarios cargadas en iCloud e informar a los intermediarios que pueden alertar al Centro Nacional para Niños Desaparecidos y Exploradores.

Otra tecnología de seguridad anunciada por la compañía utiliza el aprendizaje automático en el dispositivo para reconocer y difuminar las imágenes de abuso sexual infantil en los mensajes, alertando a los padres sobre los menores. Además, un cambio en la búsqueda y Siri, que indicaría recursos para detener CSAM si el usuario está buscando información relevante.

Sin embargo, las herramientas propuestas han sido criticadas por expertos en privacidad y seguridad, quienes argumentan que el sistema podría usarse con fines de vigilancia, particularmente por parte de gobiernos autoritarios.

Pero a mediados de agosto, la compañía dijo que no sucumbiría a la presión de los gobiernos, además de asegurarse de tener un sistema de seguridad para evitar que se divulguen y digitalicen otros tipos de imágenes.

La Electronic Frontier Foundation dijo en un comunicado el 5 de agosto que el nuevo sistema, aunque bien intencionado, «rompe las promesas clave del cifrado de mensajes y abre la puerta a abusos más amplios».