Como presentamos ayer, OpenAI ha lanzado una solución nueva y más potente. Se llama GPT-4o. Y el vídeo que tenemos para ti es una loca demostración de IA para iPad. Los estudiantes que utilicen estas herramientas cambiarán los métodos de enseñanza para siempre.

Si no viste el evento OpenAI de ayer, te recomiendo que lo hagas. La principal novedad es que el último modelo GPT-4 funciona perfectamente con cualquier combinación de texto, audio y vídeo.

Esto incluye la capacidad de "mostrar" a una aplicación GPT-4o una grabación de pantalla capturada desde otra aplicación, y es esta capacidad la que la compañía demostró con una demostración loca que explica la IA del iPad.

GPT-4o: OpenAI declaró que la letra "o" significa "omni".

Exacto, lo dudamos. Después de todo, ¿será cero o x?

GPT-4o ("el" en "omni") es un paso hacia una interacción más natural entre humanos y computadoras: acepta como entrada cualquier combinación de texto, audio e imágenes y genera cualquier combinación de texto, audio e imágenes.

Puede responder a la entrada de voz en sólo 232 milisegundos, con un promedio de 320 milisegundos, que es similar al tiempo de respuesta de un ser humano en una conversación. […] GPT-4o es particularmente mejor para comprender la visión y el sonido que los modelos actuales.

Incluso el aspecto sonoro es muy importante. Anteriormente, ChatGPT podía aceptar entradas de voz, pero las convertía a texto antes de usarlas. Ey Por el contrario, GPT-4o entiende eficazmente el audio.por lo que se salta la etapa de conversión por completo.

Como mencionamos ayer, los usuarios gratuitos también tienen acceso a muchas funciones que antes estaban limitadas a los suscriptores de pago.

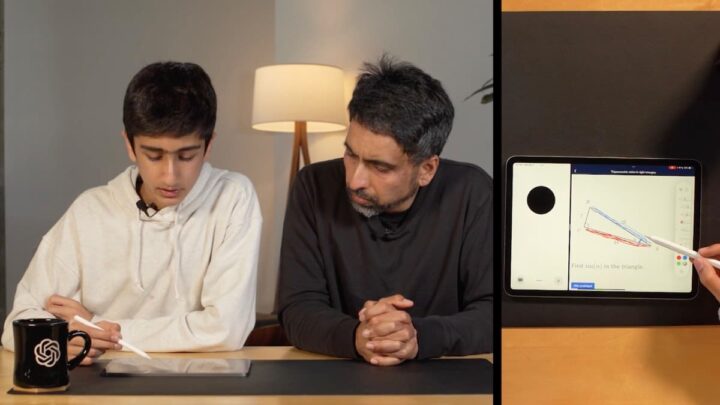

Demostración de IA para iPad

Una de las capacidades demostradas por OpenAI es la capacidad de GPT-4o de ver lo que estás haciendo en la pantalla del iPad (en modo de pantalla dividida). El ejemplo muestra una inteligencia artificial explicando un problema matemático a un estudiante.

Se puede escuchar que al principio GPT-4o entendió el problema y quiso resolverlo de inmediato. pero El nuevo modelo puede ser descontinuado. En este caso, se le pide que ayude al estudiante a resolver el problema.

Otra habilidad que aparece aquí es que el modelo pretende detectar emociones en el habla y también puede expresar sus propias emociones. Es posible que esto haya sido un poco exagerado en la versión beta y, en última instancia, podemos interpretar la IA como un poco condescendiente. Pero todo esto se puede modificar.

Efectivamente, todos los estudiantes del mundo pueden tener un tutor privado con este tipo de habilidades.

¿Hasta qué punto Apple aceptará este asunto?

Sabemos que la IA es un foco importante de iOS 18 y que Apple está ultimando un acuerdo para llevar las funciones de OpenAI a sus dispositivos. Aunque esto se describió en ese momento como para ChatGPT, ahora parece muy probable que el trato real sea para acceder a GPT-4o.

Pero también sabemos que Apple ha estado trabajando en sus propios modelos de IA, con sus propios centros de datos ejecutando sus propios chips. Por ejemplo, Apple ha estado trabajando en su propia manera de permitir que Siri entienda las pantallas de las aplicaciones.

Así que no sabemos exactamente qué capacidades GPT-4 incluirá la compañía en sus dispositivos, pero esta característica parece tan perfecta para Apple que tengo que creer que se incluirá. Esto realmente es utilizar la tecnología para empoderar a las personas.